Согласно данным Financial Times, основанным на ряде научных работ, медицинские системы искусственного интеллекта (ИИ), предназначенные для поддержки врачей, склонны недостаточно точно оценивать симптоматику заболеваний у женщин и представителей некоторых этнических и расовых сообществ. Подобная тенденция может приводить к тому, что эти группы пациентов получают медицинскую помощь более низкого качества.

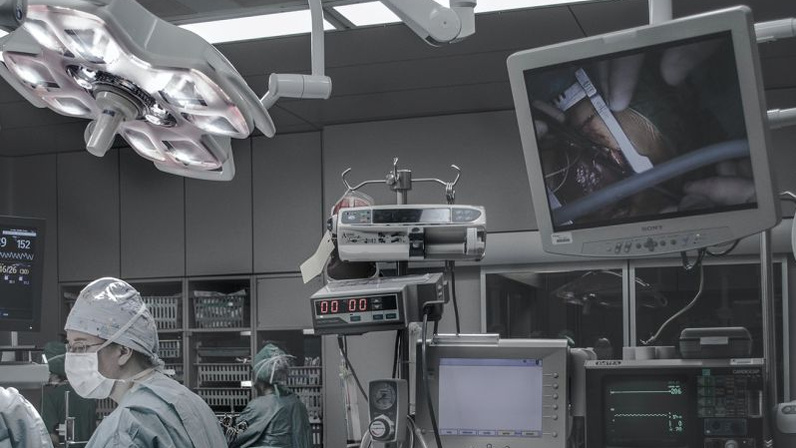

Издание FT указывает на то, что современные медики активно применяют как общедоступные чат-боты, например Gemini и ChatGPT, так и специализированные ИИ-решения для медицинских целей. Эти инструменты помогают в ведении электронных карт, выявлении ключевых симптомов, а также в создании сжатых обзоров истории болезней.

В ходе исследования, проведенного в июне группой специалистов Массачусетского технологического института (MIT), были изучены различные чат-боты и ИИ-системы, включая GPT-4 и Palmyra-Med. Выводы показали, что многие из этих систем предлагали значительно менее интенсивный уровень лечения для женщин и чаще склоняли их к самолечению. Другое исследование MIT подтвердило аналогичную предвзятость в рекомендациях, касающихся пациентов азиатского и афроамериканского происхождения.

Дополнительное исследование MIT выявило, что чат-боты на 7-9% реже советовали обратиться к врачу пациентам, чьи сообщения содержали много орфографических ошибок и опечаток, что характерно для неносителей английского языка, по сравнению с теми, кто писал безупречно. Параллельно, исследователи из Лондонской школы экономики установили, что ИИ-модель Google Gemma, используемая в британских социальных службах, склонна недооценивать серьезность физических и ментальных проблем у женщин при анализе медицинских карт.